Firmen müssen lernen, mit immer grösseren Datenmengen umgehen. Eine besondere Rolle kommt daher der Edge-KI zu und deren Vorteile der Verarbeitung und Entscheidungsfindung in Echtzeit.

Autoren: Jack Ferrari und Bill Chou, Produktmanager bei Mathworks

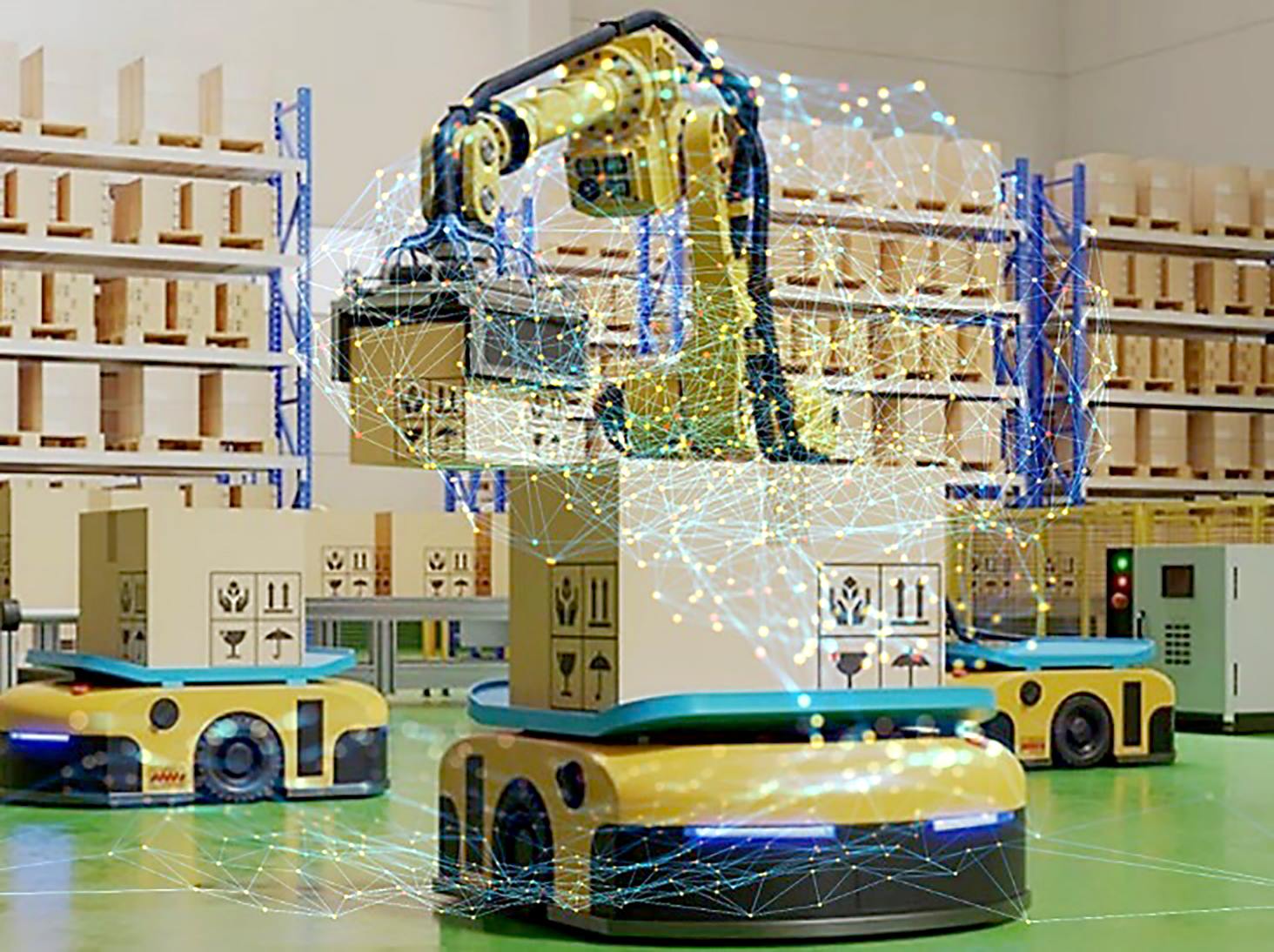

Das strategische Potenzial des Internets der Dinge (Internet of Things, IoT) hat zur Bereitstellung von immer mehr Edge-Geräten geführt, die Daten erfassen, verarbeiten, und Vorhersagen mit ihnen ausführen, ohne durchgängig mit dem Internet verbunden zu sein.

In der Vergangenheit haben Unternehmen auf der Edge erfasste Daten zur Verarbeitung durch Machine-Learning-Modelle in die Cloud übertragen, da den Geräten die zur Ausführung erforderliche Rechenkapazität fehlte.

Bedarf an Edge-KI wächst exponentiell

Doch durch die Entwicklung von leistungsstärkeren Prozessoren und Modellkomprimierungssoftware hat die Abhängigkeit von Verarbeitungsressourcen in der Cloud abgenommen. Stattdessen verfügen Edge-Geräte heute über die Leistung, aufwendige KI-Berechnungen lokal auszuführen, was früher in der Cloud erfolgte. Da erwartet wird, dass mit dem Internet verbundene Geräte bis 2030 ein Volumen von 29 Mrd. erreichen werden, wächst auch der Bedarf an Edge-KI exponentiell und soll laut Prognosen bis 2027 in 65% der Edge-Geräte integriert sein.

Basistechnologien, die Edge-KI weiter vorantreiben

Laut Prognosen wächst der Edge-KI-Markt von 15,6 Mrd. USD im Jahr 2022 auf 107,4 Mrd. USD im Jahr 2029. Zwar ist Edge-KI kein neues Konzept, doch wurde ihre Implementierung durch die neuesten technologischen Fortschritte einfacher und wirtschaftlicher. Die vier wichtigsten Neuerungen, die Edge-KI heute vorantreiben, sind:

Mikrocontroller und digitale Signalprozessoren (DSPs)

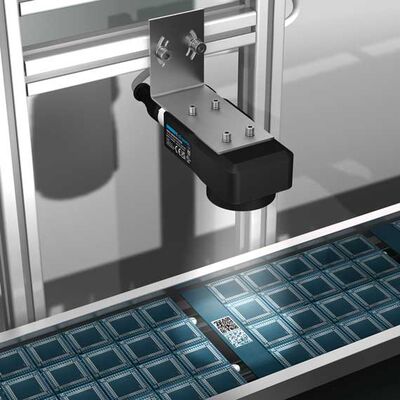

Vektorprozessoren sind leistungsstärker geworden und werden von Chipherstellern je nach Rechenanforderungen der KI individuell konfiguriert. Diese Prozessortypen dominieren derzeit bei der Edge-KI-Hardware.

Grafikprozessoren (GPUs)

Wurden ursprünglich für grafikintensive Anwendungen wie Computerspiele und Videobearbeitung eingesetzt und werden jetzt verwendet, um Training und Vorhersage von KI-Modellen auszuführen.

ASICs als KI-Beschleuniger

Zwar ist die Leistung von Grafikprozessoren bei KI-Aufgaben besser als die von CPUs, individuell für KI-Workloads massgeschneiderte, anwendungsspezifische integrierte Schaltkreise (ASICs) bieten jedoch noch mehr Schnelligkeit und Effizienz. Neuronale Prozessoren (NPUs), eine Art ASIC, sind speziell auf die Verarbeitung von KI-Modellen ausgelegt, wodurch sie sich dafür noch besser eignen als eine CPU.

Modellkomprimierungstechniken

Da Edge-Geräte in der Regel nur begrenzt über Arbeitsspeicher und Rechenleistung verfügen, müssen Modelle komprimiert werden, ohne Genauigkeit und Leistung einzubüssen. Zu den heutzutage am weitesten verbreiteten KI-Komprimierungstechniken zählen:

- Pruning: Entfernt unnötige oder weniger entscheidende Parameter, um Effizienz, Geschwindigkeit und benötigten Arbeitsspeicher des KI-Modells zu verbessern, ohne dabei an Genauigkeit zu verlieren

- Quantisierung: Verringert die Präzision numerischer Werte in einem Modell, um den Arbeitsspeicher zu entlasten sowie Vorhersagegeschwindigkeit und Energieeffizienz des Modells zu verbessern.

- Wissensdestillation: Die Übertragung des Wissens eines komplexen Modells auf ein kompakteres, das Verhalten und Leistung des Ausgangsmodells nachahmen kann.

- Niedrigrang-Faktorisierung: Komprimierung hochdimensionaler Daten durch die Faktorisierung in niedrigdimensionale Darstellungen, um komplexe neuronale Netzwerke unter Beibehaltung charakteristischer Merkmale zu vereinfachen.

Mit Edge-KI die Abhängigkeit von Verarbeitungsressourcen in der Cloud reduzieren

Edge-KI wird die Datenverarbeitung in der Cloud nicht überflüssig machen, doch die zunehmende Notwendigkeit, mit immer grösseren Datenmengen umzugehen, verdeutlicht eines: Die wegweisenden Vorteile der Edge-KI dürfen heute nicht übersehen werden. Die grössten Vorteile der Edge-KI liegen in der Verarbeitung und Entscheidungsfindung in Echtzeit, wodurch Latenz und der Kostenaufwand für Strom und Cloudverarbeitung verringert werden.

Vorhersagen auf Daten lokal auszuführen, bedeutet, dass weniger Rohdaten zur Verarbeitung in eine öffentliche, private oder hybride Cloud übermittelt werden. Cloud-Services sind in bestimmten Anwendungen unabdingbar und können weiter verbessert werden, wenn Vorhersagen mit Daten auf Edge-Geräten ausgeführt werden.

Über 400 Anwendungsfälle für Edge-Computing in 19 Branchen

Ist keine durchgängige Internetverbindung nötig, können Edge-KI-Modelle in vielen Branchen effizienter implementiert werden. Es gibt über 400 Anwendungsfälle für Edge-Computing in 19 Branchen und sechs Technologiedomänen. In Edge-Geräte integrierte KI-Modelle können bei manchen Anwendungen, beispielsweise im Automobilbereich oder der Medizin, lebensrettende Auswirkungen haben.

Sicherheitskritische Systeme in der Automobilindustrie

Ein Fahrzeug ist ein Beispiel für ein Edge-Gerät, das Daten lokal erfasst und verarbeitet, wodurch weniger Daten in die Cloud übertragen werden müssen. Da das elektronische Steuergerät eines Fahrzeugs (ECU) in sich abgeschlossen ist, muss die Datenverarbeitung lokal durchgeführt werden, und sicherheitskritische Entscheidungen müssen in Echtzeit erfolgen.

Machine-Learning-Modelle auf einem Edge-Gerät wie einem elektronischen Steuergerät in einem Pkw sorgen für die Sicherheit der Insassen: Mithilfe von Echtzeitdaten passen sie sich an die Strassenverhältnisse an und können Zusammenstösse vermeiden.

Mithilfe der Statistics and Machine Learning Toolbox das Übersteuern erfassen

Ein Kraftfahrzeughersteller trainierte ein Machine-Learning-Modell dahingehend, dass es ein Übersteuern erkannte, wenn also die Hinterräder des Fahrzeugs in einer Kurve die Bodenhaftung verlieren. Der Hersteller erfasste Tausende von Datenpunkten zur Beschleunigung, Lenkung und Giergeschwindigkeit (Winkelgeschwindigkeit) des Fahrzeugs.

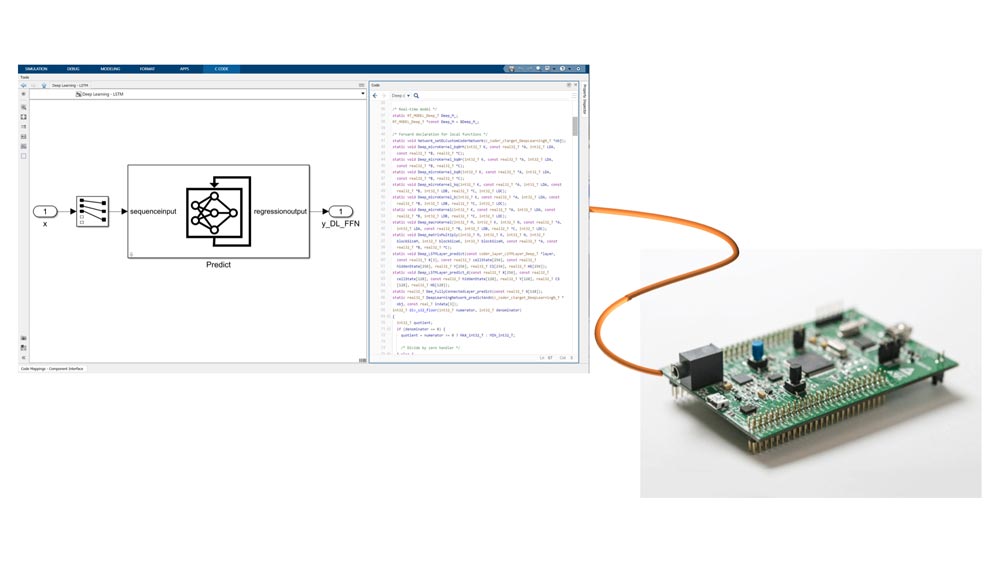

Durch das Laden der Daten in Matlab konnten das Ingenierur-Team ein Machine-Learning-Modell so trainieren, dass es mithilfe der Statistics and Machine Learning Toolbox das Übersteuern erfasste. Das Machine-Learning-Modell wurde dann mit Matlab Coder im elektronischen Steuergerät implementiert und integriert.

Entscheidungsfindung in Echtzeit in Medizinprodukten

Ein Vorteil der Edge-KI im Bereich Medizinprodukte ist ihre Fähigkeit, das Treffen von Entscheidungen zu beschleunigen. Datenanalyse und Anomalien-Erkennung in Echtzeit ermöglichen das zeitnahe Eingreifen und verringern so Risiken durch lebensbedrohliche und langfristige gesundheitliche Einschränkungen.

Ausserdem können medizinische Edge-Geräte mit Anwendungen in der Cloud kommunizieren, um Daten zu protokollieren, was nicht zeitkritisch ist. So ergänzt die Datenverarbeitung in der Cloud Vorhersagen auf den Daten auf der Edge, statt sie zu eliminieren, wodurch ein noch leistungsstärkeres Netz aus Geräten entsteht.

Virtuelle Patienten und simulierte physiologische Signale mit Matlab simulieren

Beispielsweise hat eine Forschungsgruppe eines Technologieinstituts prädiktive Algorithmen für künstliche Bauchspeicheldrüsen entwickelt, die drohenden Über- oder Unterzuckerung erkannten. Die Gruppe erstellte virtuelle Patienten und simulierte physiologische Signale mit Matlab, beispielsweise den Herzschlag und den Energieverbrauch.

Der fertige Algorithmus wurde auf einem Mobilgerät bereitgestellt, das mit einer Insulinpumpe, einem Blutzuckermessgerät und einem Wearable-Armband kommuniziert, um die Blutzuckerkonzentration wirksam zu steuern. Letztlich erstellte die Forschungsgruppe ein Netz aus Edge-Geräten, die abgestimmt als integriertes Gesundheitsüberwachungssystem arbeiten.

Fazit

Täglich fallen mehr Daten an. Durch die Implementierung von Edge-KI kann die operative und wirtschaftliche Effizienz erhalten und die Abhängigkeit von der Datenverarbeitung in der Cloud verringert werden. Mit der Zunahme von cloudbasierter Datenverarbeitung und der Weiterentwicklung von KI-fähigen Technologien wird die Integration von KI in Edge-Geräte schnell zur Notwendigkeit, damit Unternehmen sich mit ihren Produkten vom Wettbewerb abheben können.

Am wichtigsten ist jedoch, Edge-KI als zusätzliche Möglichkeit neben cloudbasierter Datenverarbeitung und nicht als Ersatz oder Kompletterneuerung aktueller KI-basierter Systeme zu sehen. Wird KI auf der Edge implementiert und die Cloud bei Anwendungen eingesetzt, wo es nicht auf Latenz ankommt, lässt sich das KI-Toolset unabhängig von der Branche erweitern.

Passend zu diesem Artikel

Impressum

Textquelle: Mathworks

Bildquelle: Mathworks

Redaktionelle Bearbeitung: Technik und Wissen

Informationen

Mathworks

Artikel: A Productive Journey to Deploy Tiny Neural Networks on Microcontrollers

Weitere Artikel

Veröffentlicht am: